嫌图片太大?!有卷积神经网络帮忙,生成高质压缩图像不再难

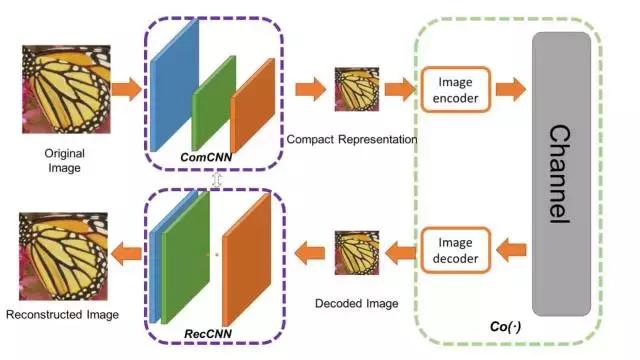

ComCNN开元ky888棋牌官网版,将紧凑表示传递给标准编解码器

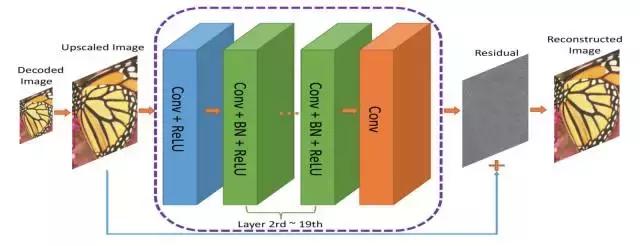

RecCNN接收ComCNN的输出进行放大,随后将信号输入RecCNN开元ky888棋牌官方版,该网络旨在掌握差异

来自编解码器的结果经过放大处理,接着送入RecCNN。RecCNN会试图生成一个和原始图像相近的图像。

一种用于图像压缩的完整流程体系,Co代表图像压缩方法,该作者采用JPEG、JPEG2000以及BPG格式来实施操作。

什么是残差?

残差能够当作一种后续处理手段,目的在于“优化”解码器还原的图像质量。那些掌握大量关于现实世界“资讯”的网络开元棋官方正版下载,能够针对“修正”问题做出判断。这一观念的来源是残差学习理论,详细内容请查阅相关文献。

损失函数

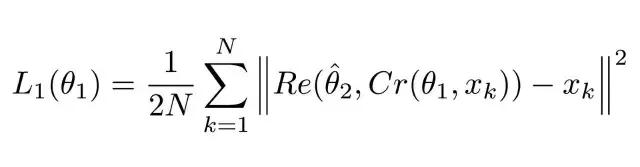

因为存在两条网络线路,因此需要设置两个不同的代价函数,首个,针对ComCNN,称作L1的代价函数具体表述如下:

等式1.0用于 ComCNN的损失函数

说明

这个公式看似繁难,其实属于常用(均方误差)MSE类型。其中那个||²符号,指的是向量整体的大小度量。

等式1.1

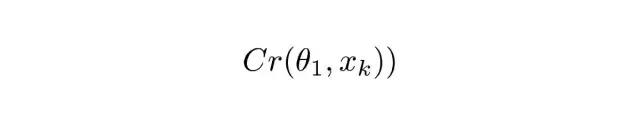

Cr是ComCNN的生成结果,θ是ComCNN的可调参数,Xk是待处理的图像

等式1.2

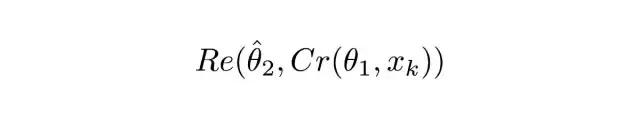

Re代表RecCNN,这个公式把等式1.1的数值传给了RecCNN,θ^是RecCNN里可以调整的参数,而带脱帽的符号则表示参数是固定的

直观的定义

公式1.0会促使ComCNN调整其参数,以便在RecCNN重构完成时,所得最终图像能最大程度地匹配原始输入图像。

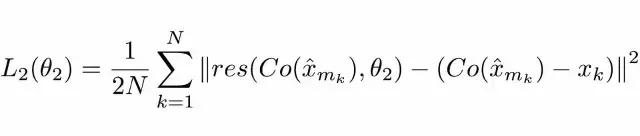

RecCNN的第二个损失函数定义为:

公式2.0

说明

这个函数看似繁复,其实属于常见标准神经网络所欠缺的一种损失函数,即均方误差。

公式2.1

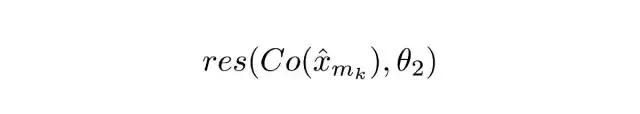

Co代表解码器的结果,x^是ComCNN的产物,θ2是RecCNN的可调参数,res仅指网络习得的偏差,是RecCNN的产物,值得注意的是,RecCNN训练的是Co与原始图像的偏差,而非直接从图像数据入手。

直观的定义

公式2.0将促使RecCNN调整其参数,让它的结果更贴近初始图像,尽可能保持一致。

训练安排

这些模型逐步进行训练,方法类似GAN的训练过程。其中,一个模型的参数保持不变,而另一个模型的参数会进行调整。当调整参数的模型固定时,另一个模型会进行训练。

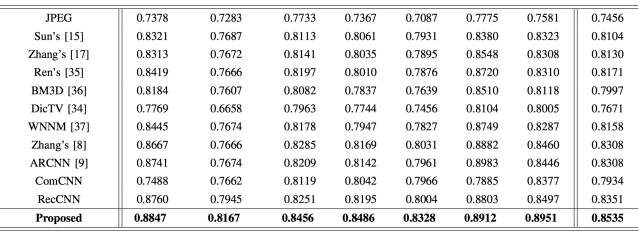

基准

作者拿自己的办法和已有办法做了对比,涵盖了解码器跟编码器。自家的办法比其余办法运行得更为出色,并且在使用普通设备时速度很快。作者试着只用一个网络,结果发现效果变差了。

图3.0 展示了结构相似度指数的对比情况。数值越高,代表与原始图像的相似程度越好。作者创作的部分以加粗字体呈现。

结论

我们探索了一种基于深度学习技术的图像压缩方案,该方案探讨了神经网络在图像分类、语言处理之外领域的应用潜力,这种方案在现有技术基础上表现优异,并且能够显著提升图像处理效率。