3个经典的卷积神经网络案例分析

本文会把 Alex-Net 作为一个范例 ,还会将 VGG-Nets 当作示例 ,同样会以 Network-In-Network 作为案子 ,继而分析几类经典的卷积神经网络案例 。

在这里请各位读者留意,这里所进行的分析比较开yun体育官网入口登录app,并非是不同网络模型精度之间的那种“较量”,而是想要让读者去体会卷积神经网络从开始一直到现在的发展脉络以及趋势。

这样子,会更有益于对于卷积神经网络的领会,进而通过类推能知其他,提高解决实际问题的本领。

01

Alex-Net 网络模型

计算机视觉领域里,Alex-Net 是首个被广泛关注且使用的卷积神经网络,尤其在 2012 年 ImageNet 竞赛中,Alex-Net 凭借超过第二名 10.9 个百分点的优异成果一举夺冠,进而打响了卷积神经网络以及深度学习在计算机视觉领域当中研究热潮的“第一枪”。

Alex - Net是被加拿大多伦多大学的Alex Krizhevsky、Ilya Sutskever(这位Ilya Sutskever是G. E. Hinton的两位博士生当中的一位)以及Geoffrey E. Hinton所提出的,网络的名称“Alex - Net”是从第一作者的名字那里取来的。

以 Alex 在网络方面有着一则八卦,鉴于 Alex-Net 具备划时代的那种意义,并且借由这种意义从而开启了深度学习于工业界的应用 。

2015年,作者Alex被Google以传闻高达3500万美金的高价收买。同一年,作者Ilya也因高额赏金,投奔Google麾下。还是在2015年,“半个”Hinton同样接受Google重金诱惑,成为其中一员。

但是,为什么会说起“半个”Hinton呢?这是因为,在那个时候,Hinton仅仅是把一半的时间投入到Google的工作之中,并且,与此同时,另一半的时间依旧是留在多伦多大学的。

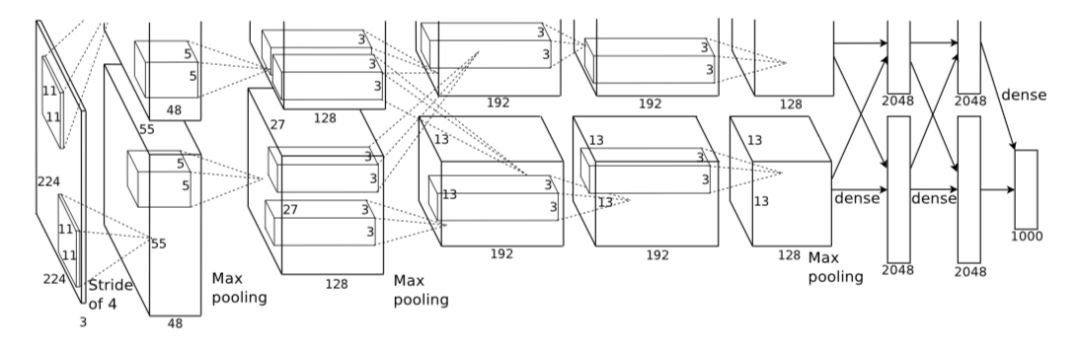

如图所示那种,展现的是 Alex-Net 的有关网络结构,它总共包含着五层卷积层,及其另外还有三层全连接层在一起。当中呢,Alex-Net 的上面一支与下面一支,那种设置是为了达成方便同时运用两片 GPU 进行并行训练这种目的,只是呢,在第三层卷积以及全连接层的位置,上面一支与下面一支之间的信息是可以相互交互的。

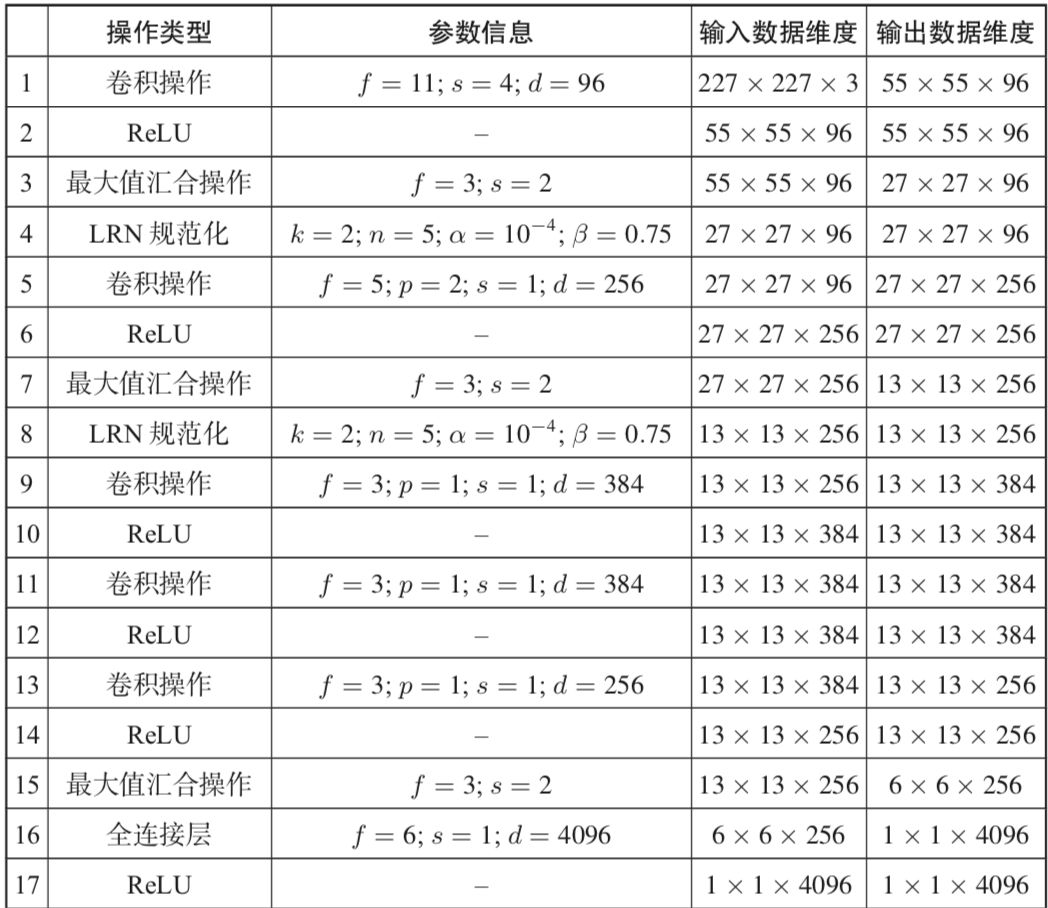

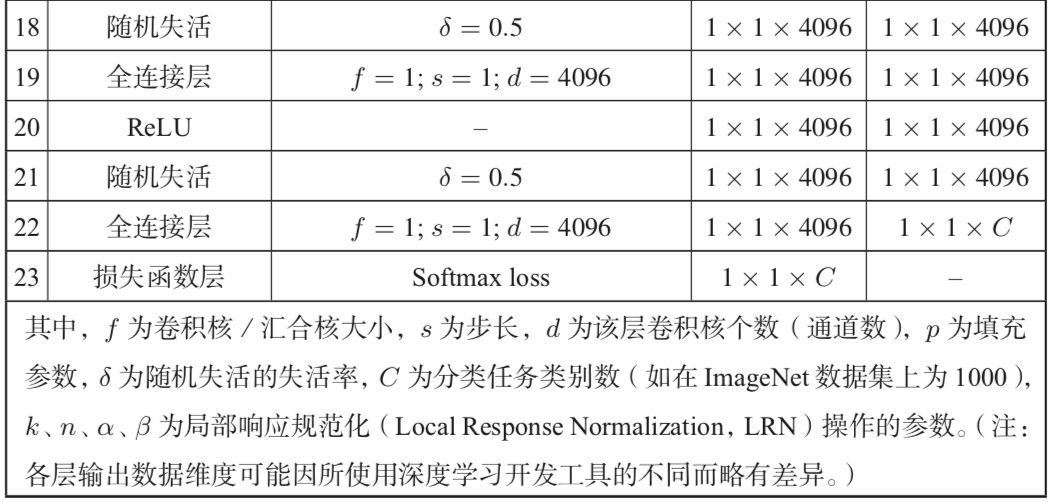

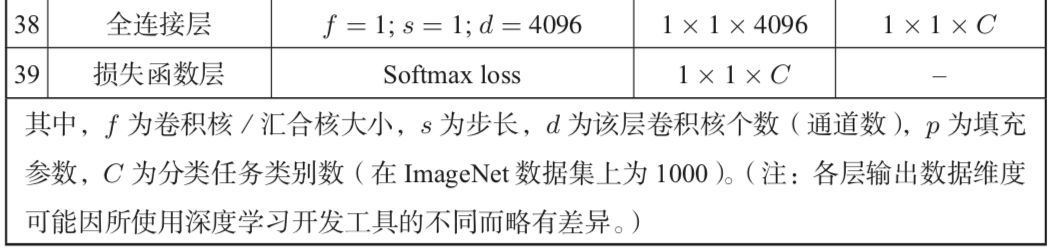

因这两支网络在各方面完全趋同一致,于现情境当选取单一支作为深入解读考查的切入点聚焦剖析细节。下方详细表格以精细有序且维度多样方式尽数展呈列出Alex-Net整体精准脉络架构轮廓与详细数据、实例说明明晰标注呈现以说明解释其所具备的具体参数信息。

就在单单于网络结构或者基本操作模块这方面而言 ,Alex-Net的改进是极其微小的 ,构建其网络的基本思路的变化是不大的 ,仅仅只是在网络深度以及复杂度上有着比较大的优势 。

图1 Alex-Net 网络结构

Alex-Net 网络架构及参数

不过,仍需要将 Alex-NNet 的几点重大贡献指出来,正是在此种情形之下,Alex-NNet 才能够在于整个卷积神经网络,以及连接主义机器学习发展进程里,占据具有里程碑意义的地位。

在计算机视觉领域,Alex-Net 首次把卷积神经网络应用于海量图像数据集 ImageNet,其图像总数共约 128 多万张,分属 1000 类,该应用揭示了卷积神经网络具备强大的 学习能力以及表示能力。

海量数据在另一方面,让卷积神经网络成功避免过拟合开元棋官方正版下载,二者相辅相成,缺一而不可,深度学习随后被引发,特别是卷积神经网络在计算机视觉领域出现“井喷”式研究。

以 GPU 达成网络训练,于上一轮神经网络研究热潮之际,鉴于计算资源发展受制约,研究者没办法借助更高效计算手段比如 GPU,这相当大地对当时神经网络研究进程形成了阻碍 。

有这样一句话,“若是工匠想要让其要施行之事达到完善的程度,那么必定在事先使所使用之器具变得锋利便利”,在 Alex-Net 当中,从事研究的人员是凭借 GPU 把原本质需要花费在数周亦或是会经过几个月之久的网络训练进程大幅度缩短到了 5 至 6 天 。

卷积神经网络强大能力被揭示的同时,这明显把深度网络、大型网络模型开发研究的周期极大缩短了,还降低了时间成本。迭代周期得此缩短,正因如此,数量众多、立意新奇的网络模型还有应用才如雨后春笋般涌现不息 。

某些训练技巧的引入,致使“不可为”情形转变成为“可为”之势,甚至进一步演化为“大有可为”之态,像 ReLU 激活函数、开展局部响应规范化操作、为避免过拟合所施行的数据增广(data augmentation)举措、以及随机失活(dropout)处理这类。

这些训练技巧,保证了模型性能,更重要的是,为后续深度卷积神经网络的构建,提供了范本,实际上开yunapp体育官网入口下载手机版,此后的卷积神经网络,大体都遵循这一网络构建的基本思路 。

对卷积结果进行规范化之事便是局部响应规范化的要求其中,此需针对相同地点对应深度上彼此邻家的卷积结果来落实它呢,这个特定位置就是处于同一的空间位置呀,并涉及相邻深度这一情况哟。

假定adi,j是第d个通道的卷积核于(i,j)位置那儿的输出结果也就是响应,接着经由ReLU激活函数发挥作用,其局部响应规范化后的成果bdi,j能够被表述为:

当中,n把使用LRN的相邻深度卷积核数目给指定了,N是该层全部卷积核数目。k、n、α、β等属于超参数,要借助验证集来进行选择,在原始Alex - Net里边这些参数的具体赋值如同上表所展示的那样。

运用 LRN 之后,于 ImageNet 数据集里,Alex - Net 的性能在 top - 1 错误率方面降低了 1.4%,在 top - 5 错误率方面降低了 1.2%;另外,有一个四层的卷积神经网络,运用 LRN 之后,在 CIFAR - 10 数据上的错误率从 13%下降到了 11%。

LRN当前已然作为各个深度学习工具箱的标准配置,把k、n、α、β等超参数略微做些改变就能达成其他经典规范化操作,比如当“k = 0,n = N,α = 1,β = 0.5”之际便是经典的l2规范化:

02

VGG-Nets 网络模型

VGG - Nets,是由著名研究组成的那个英国牛津大学的VGG(Visual Geometry Groups)所提出 ,它是成为2014年ImageNet竞赛排名在定位任务(localization task)这一项里处于第一名 ,和在分类任务里处于第二名做法当中的基础网络 。

因VGG - Nets有着良好的泛化性能,所以其在ImageNet数据集上的预训练模型,也就是pre - trained model,被广泛应用于除最常用的特征抽取,即feature extractor之外的诸多问题句号

就像物体候选框生成一样,还有细粒度图像定位与检索,以及图像协同定位等 。

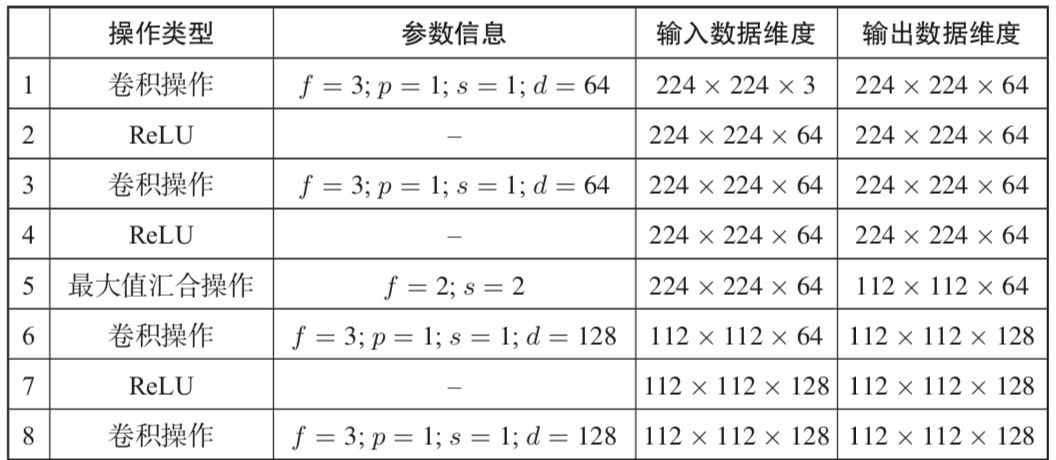

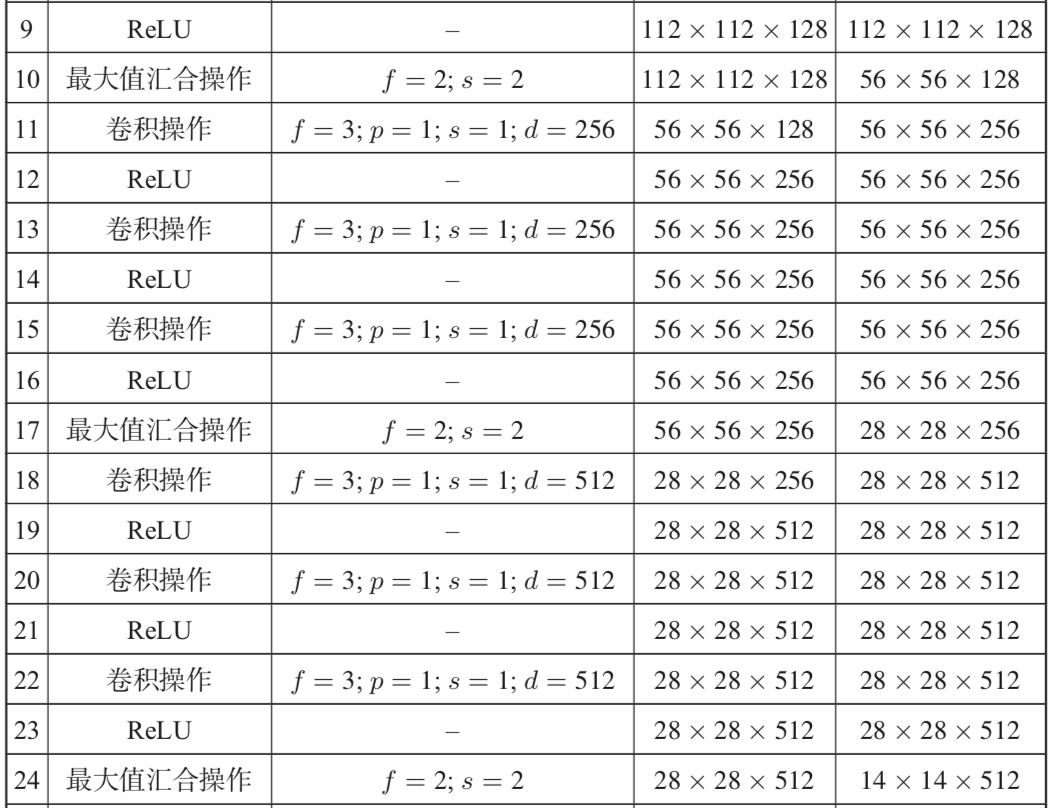

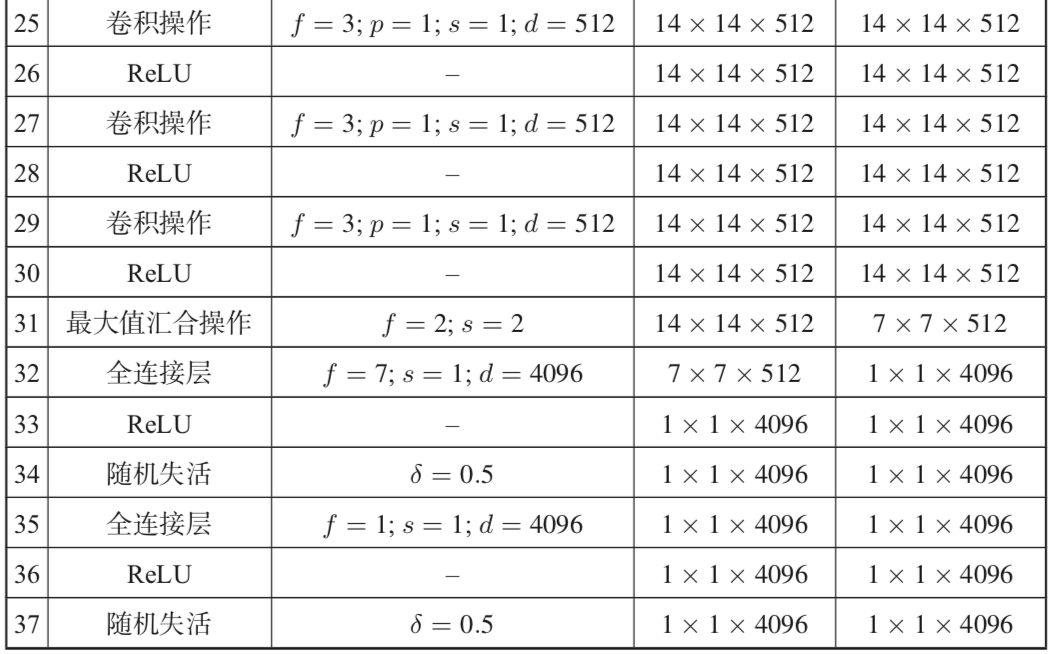

选取 VGG-Nets 里具代表性的 VGG-16 做例子,下面的表格将其每层详尽的参数信息给罗列了出来。

可以被发现,相较于 Alex-Net,VGG-Nets 之中广泛地运用了小的卷积核以及“维持输入大小”这类技巧,其目的在于,当增加网络深度也就是网络复杂度之际,保证各层输入大小随着深度的增加而不会急速地减小。

与此同时,在网络卷积层当中,其通道数,也就是 channel,先是从 3 起,然后朝着 64 递增,接着又从 64 朝着 128 递增,随后再是从 128 朝着 256 递增,最后从 256 朝着 512 逐次渐变增加。

VGG-16 网络架构及参数

03

Network-In-Network

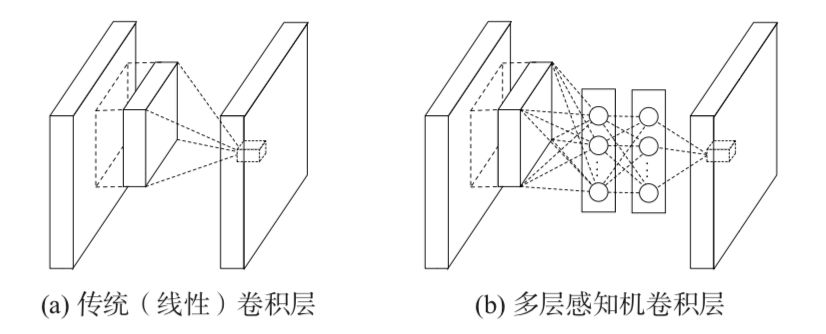

Network-In-Network即NIN,是一类经典网络模型,它有别于传统卷积神经网络,由来自新加坡国立大学的LV之实验室所提出,该经典网络模型与别番卷积神经网络存有最大差异之处,此差异在于其所运用针对先前卷积网络内简易线性卷积层予以替代的方式,采用的是多层感知机方式进行替代,多层感知机乃是多层全连接层与非线性函数二者相组合而成,情形如同下方图示这般 。

我们清楚,线性卷积层之处复杂度受限,借助线性卷积来实施层面映射,亦只是可就上层特征或者输入予以

由“简单”的线性组合构成下层特征,NIN采用多层感知机作为层间映射形式,这种多层感知机复杂度更高,这在一方面提供了网络层间映射的新可能。

网络卷积层的非线性能力得以增加,上层特征要以更复杂的形式映射到下层,这样的想法被后期问世的残差网络参考,也被Inception等网络模型借鉴。

图2 传统卷积模块(a)与 NIN 网络卷积模块(b)

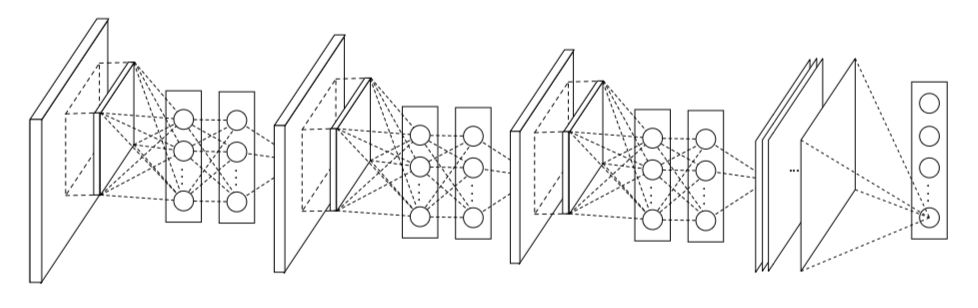

与此同时,NIN网络模型有所谓的另一个重大突破之处,此突破点乃在于拒绝采用全连接层当作分类层的传统做法,而是转换成选用全局汇合操作,也就是global average pooling,情况呈现如下图示,句号。

NIN的最后一层存在着C张特征图也就是feature map ,C个类别与分类任务相互对应分别是上述各个特征图 ,全局汇合操作适用于每张独特特征图 ,汇合结果最终映射至样本真实标记这一结果 。

能够发觉,在这般的标记映射关系情形下,C张特征图之上的响应会很自然地各自对应到C个不一样的样本类别,这同样是相对于先前卷积网络而言,NIN在模型可解释性方面的一个优势。

图3 NIN 网络模型整体结构

在这个示例里,NIN将三个多层感知机卷积层模块进行了堆叠,并且还有一个全局汇合操作层,此全局汇合操作层被用作分类层。

作者叫魏秀参,是南京大学 LAMDA 研究所的博士,其主要研究的领域是计算机视觉,还有机器学习 ,她在相关领域重要国际期刊以及国际会议发表了十余篇论文 ,并且担任 ICCV、CVPP、CVPR、ECCV、NIPS、IJCAI、AAAI 等国际会议的 PC member 。