pg下载 3.4 探索卷积网络

3.4 探索卷积网络

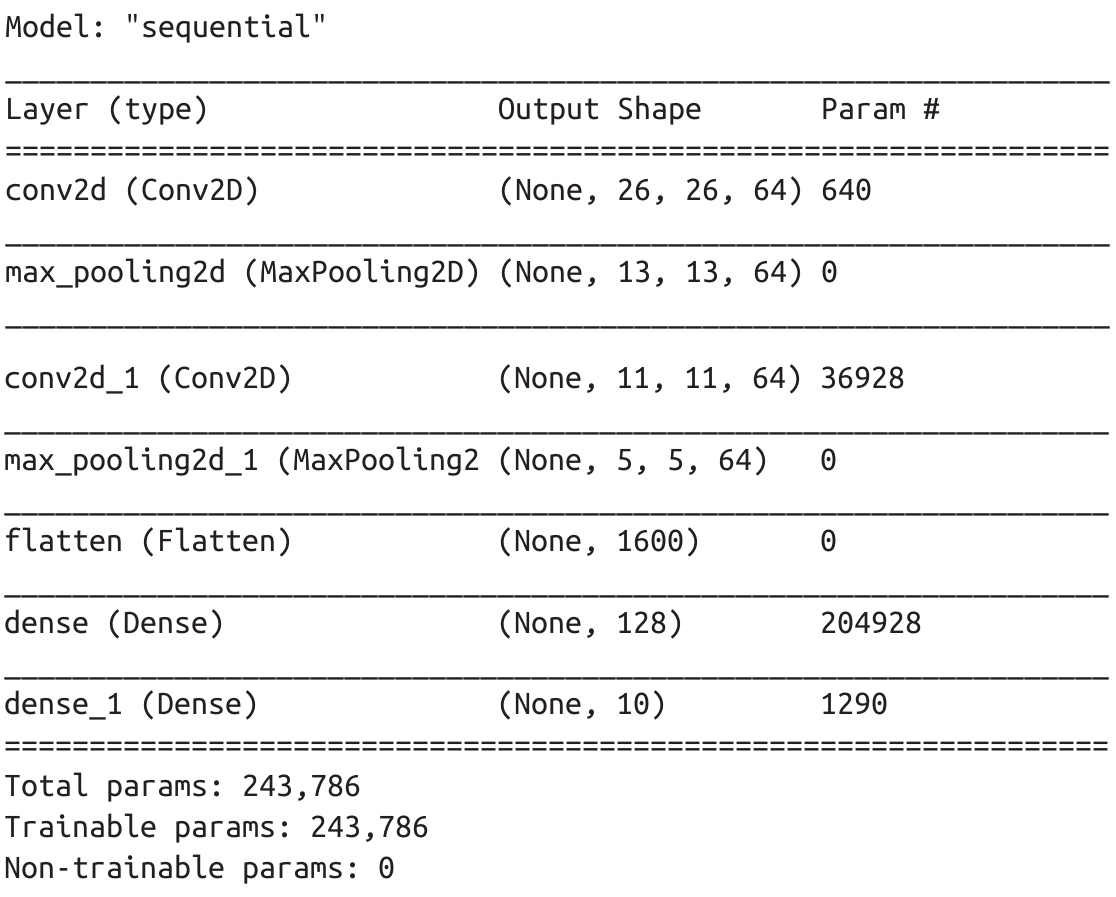

采用model.summary命令,你能够对模型予以检查。当在我们始终运用的基于Fashion MNIST的卷积网络之上运行此命令之际,会见到如下结果:

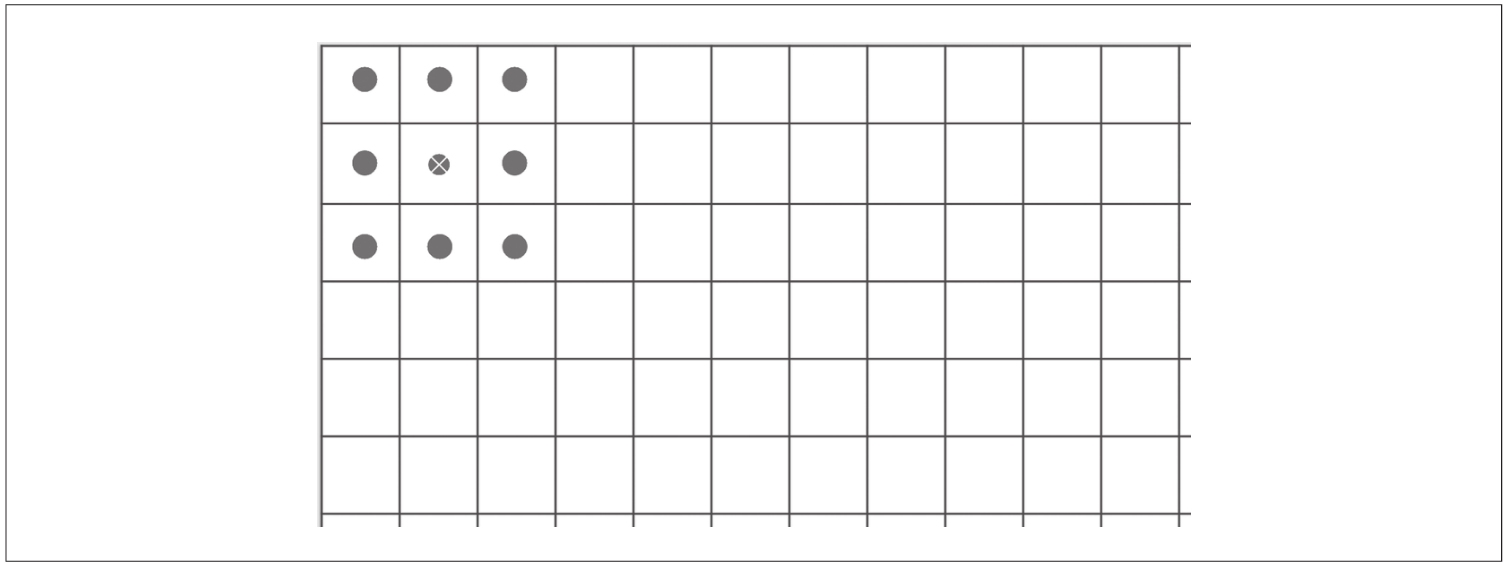

使我们最先查看标着Output Shape(输出形状)的这一列,以此去明白在此处发生的状况。头一层会存在呈现为28×28的图像,并且在这些图像上面运用64个滤波器。然而鉴于滤波器是3×3的,图像周边1像素宽度的边框会缺失,从而把总的信息削减成26×26像素。参照图3 - 6 。要是我们把图像里的每个像像素视为一个框,那么首个能够使用的滤波器起始于第二行以及第二列。与在图像的右边出现的情况一模不一样,在图像的下边也会存在对等的情形。

图3-6:运行滤波器时会丢失像素

所以,在进行一个3×3的滤波器运行操作时,具有A×B这种形状的一幅图像,其形状将会变换为(A - 2)×(B - 2)像素。与之相似地,一个5×5的滤波器会使得图像变成(A - 4)×(B - 4),按照这样的规律类推下去。鉴于我们所采用的是28×28的图像以及3×3的滤波器pg下载,所以最终输出的是26×26 。

在那之后,池化层为2×2,所以图像的每个尺寸均会减半,进而它会变成13×13。下一个卷积层会将其进一步缩减为11×11,随后下一个池化层会使图像变为5×5。

所以,在图像历经两个卷积层之际,其结果会转换成好多5×5的图像。数量是多少呢?我们能够于Param #(参数)这一列寻觅到 。

每一个卷积都身为一个3×3的滤波器,还额外附带一个偏差。还记得先前的密集层,每一层都是Y=mX+c这个样子,其中m是参数也就是权重,而c是偏差。此处的情况与之极为相似,只是这里的滤波器是3×3规格的,所以存在9个参数有待学习。已知我们已然定义了64个卷积,那么总共就有640个参数(每个卷积有9个参数再加一个偏差,所以总共是10个参数,并且存在64个滤波器)。

MaxPooling层不会去学习任何参数,它仅仅是对图像大小进行缩减,所以在那里并不存在需要学习的参数,故而所报告的结果是0。

下一个卷积层存在64个滤波器情形,然而每一个滤波器均是跟之前的64个滤波器做相乘运算,并且每一个滤波器涵盖9个参数。我们于每一组新的64个滤波器里都纳入一个偏差,所以参数个数应当是(64×(64×9))+64这一式子的结果pg下载麻将胡了,最终结果表明网络需要去学习36 928个参数。

倘若你存有困惑之感,那么可以试着去改变第一层的卷积数量,比如说,是10这个数值。如此一来,你将会目睹第二层的参数数量进而变为5824,此数量也就是(64×(10×9)+64)这般的计算结果。

图像大小是5×5,当经过第二个卷积时,有64个这样的图像,把这些数字相乘,得到1600个值,这些值会被传入下一个包含128个神经元的密集层,每个神经元包含一个权重和一个偏差,有128个神经元,所以网络需要学习的参数个数为((5×5×64)×128)+128,即204928个参数。

最后的密集层有着10个神经元,它收到了前面128个神经元给出的输出,因此所要学习的参数是这般计算的,即(128乘以10)加上10,算得的结果是1290个 。

把这些数字全部加起来,总的参数个数为243 786。

要训练一个神经网络,需学习那243786个参数的最优集合,以此把输入图像匹配到其标签上。这是个极为缓慢的过程,缘由是参数的数量增多了,然而我们能够从结果里看出,这同样构建起了一个更为准确的模型!

当然,该数据集的使用存在一个缺陷,此缺陷在于pg下载赏金下载,图像大小均为28×28,且为单色,同时处于居中状态的。接下来,我们将查看利用卷积探索一个更复杂的数据集,该数据集涵盖马和人的照片,并且我们会尝试判别一个图像是否包含其中一种类型。在这种情形下,主体对象不一定会像Fashion MNIST般处于图像的中央,所以我们需要依靠卷积来识别突出的特征。