pg下载麻将胡了A.旗舰厅进体育.cc 卷积神经网络在机器翻译中的应用

卷积神经网络在机器翻译中的应用

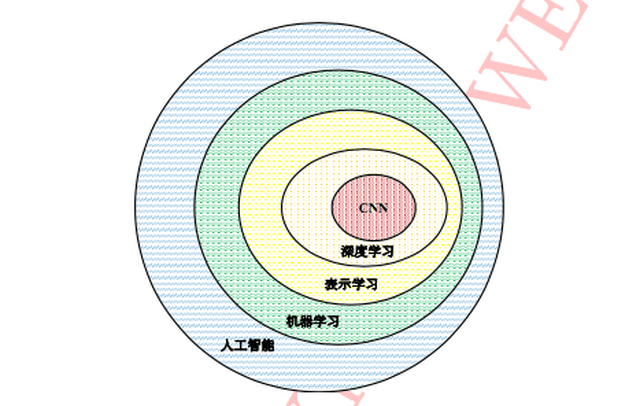

有着广泛应用的卷积神经网络,也就是CNN,是一种经典的神经网络结构,它在自然语言处理领域被广泛运用,它和循环神经网络也就是RNN不一样pg下载赏金下载,它每一步的计算并不依靠前一步的结果,所以它能够充分借助GPU的并行计算能力。

ConvS2S的整体结构

ConvS2S的整体结构呈现于图8.34,其编码器(位于图片上侧)和解码器(处于图片左下侧)具体借助CNN来实现,以此对源语言与目标语言的特征予以提取。这种模型构造致使每一层的网络运算能够达成完全并行化。经由堆叠多层CNN结构,上下文窗口的范围持续拓展得以实现,进而逐步对输入文本里的远距离依赖进行建模。

ConvS2S的主要部件 ️

位置编码,ConvS2S由于摒弃了循环结构,所以在输入层要引入位置编码,用以标识输入序列里词与词之间的相对位置关系。

卷积层,与门控线性单元,编码器,采用门控卷积结构,作为建模源语言的基本部件pg下载通道,这一部件,由序列维度上的一维卷积运算,和非线性门控机制结合而成,对于解码器而言,同样如此。卷积过程,能够有效地建模待处理文本中的局部上下文信息,而序列中的长程依赖问题,可通过多层卷积结构的堆叠得到缓解。非线性门控机制,使得我们能够建模输入视野下更加复杂的依赖关系。

残差连接,在编码器里,于堆叠的多层 CNN 结构中增加了该结构,在解码器里,同样于堆叠的多层 CNN 结构中增加了此结构,它们直接连接每一层的输入与输出,以此来提高信息传播效率,进而减小模型的优化难度。

多步注意力机制,它不同于有别的,类似于循环神经机器翻译模型之处在于,ConvS2S采用注意力机制,以此从源语言端自适应检索译文相应渊源那语言信息来着。不一样的地方在于,这儿注意力计算会在解码器每一层出现而被叫做“多步”注意力。符号。

门控卷积结构

编码器采用门控卷积结构作为建模源语言的基本部件,解码器也采用门控卷积结构作为建模目标语言的基本部件,这一部件由序列维度上的一维卷积运算与非线性门控机制结合而成,卷积过程能有效建模待处理文本中的局部上下文信息,序列中的长程依赖问题可通过多层卷积结构的堆叠得到缓解,非线性门控机制能让我们建模输入视野下更为复杂的依赖关系。

多步自注意力机制

解码器采用了堆叠多层的门控卷积结构,以此来完成对目标语言的解码,其在每一层门控卷积之后,借助注意力机制pg下载,通过这样的方式,解码器能够自适应自源语言端检索译文对应的源语言信息,进而实现更为精准的翻译。

在机器翻译当中,卷积神经网络获应用,这致使模型得以更优地运用GPU的并行计算能力,进而提升翻译的准确性以及效率。